大模型训练与推理显存占用全解析:从理论估算到实战优化

随着大语言模型(LLM)参数规模从百亿跃升至万亿,显存(GPU Memory)已成为制约其研发与应用的核心瓶颈。无论是训练时的“显存爆炸”,还是推理中的“缓存激增”,都直接关系到硬件成本、部署门槛和最终性能。本文将深入拆解大模型训练与推理的显存占用机制,并提供一套从理论估算到工程优化的完整方案。

一、显存占用的核心构成:不只是参数

显存占用并非简单地由模型参数数量决定。它是一个动态的系统性开销,主要来源于以下三个部分:

1. 模型参数存储

这是最基础的部分。存储精度直接决定了占用量。例如,一个拥有320亿参数(32B)的模型,在FP16精度下,参数本身约占用64GB显存(32B × 2字节)。若采用INT4量化,则可压缩至仅16GB。

2. 优化器状态(训练阶段特有)

这是训练时显存需求远高于推理的主要原因。以常用的Adam优化器为例,它为每个参数需要维护动量(一阶矩) 和方差(二阶矩) 两个状态,通常以FP32精度存储。这意味着,优化器状态的开销可达参数本身的4-8倍。对于一个32B的FP16模型,仅优化器状态就可能额外占用128GB以上的显存。

3. 中间激活值与KV缓存

激活值:在模型前向传播过程中,每一层产生的中间输出(激活值)需要被保留,用于后续的反向传播计算。其总量与批处理大小(Batch Size) 和输入序列长度成正比。对于长序列训练,激活值可能成为显存消耗的主力。

KV缓存:在推理阶段,Transformer的自注意力机制需要缓存之前所有计算过的键(Key)和值(Value)向量,以加速后续token的生成。KV缓存的占用与序列长度、批处理大小、模型层数和隐藏维度直接相关。例如,Llama 3 70B模型在处理128K tokens的上下文时,仅KV缓存就可能占用约40GB显存。

二、训练与推理:显存需求的两重天

训练和推理阶段的显存需求存在数量级差异,理解其区别是进行资源规划的第一步。

一个具体的案例:DeepSeek R1满血版(1750亿参数)在批处理大小为16的推理任务中,总内存需求达到了惊人的448GB。这其中包括了约350GB的模型参数和约420GB的KV缓存。

三、如何估算显存占用?

在实际操作前进行显存估算至关重要,这里有理论公式和经验法则两种方法。

1. 理论估算公式(基于Transformer架构)

研究指出,训练基于Transformer的大模型所需内存可近似为:

层数 × 批次大小 × 序列长度 × 隐藏层维度 × 精度 × 一个远大于1的常数。

这反映了显存占用与模型深度、输入规模的高度非线性关系。

2. 实用经验法则

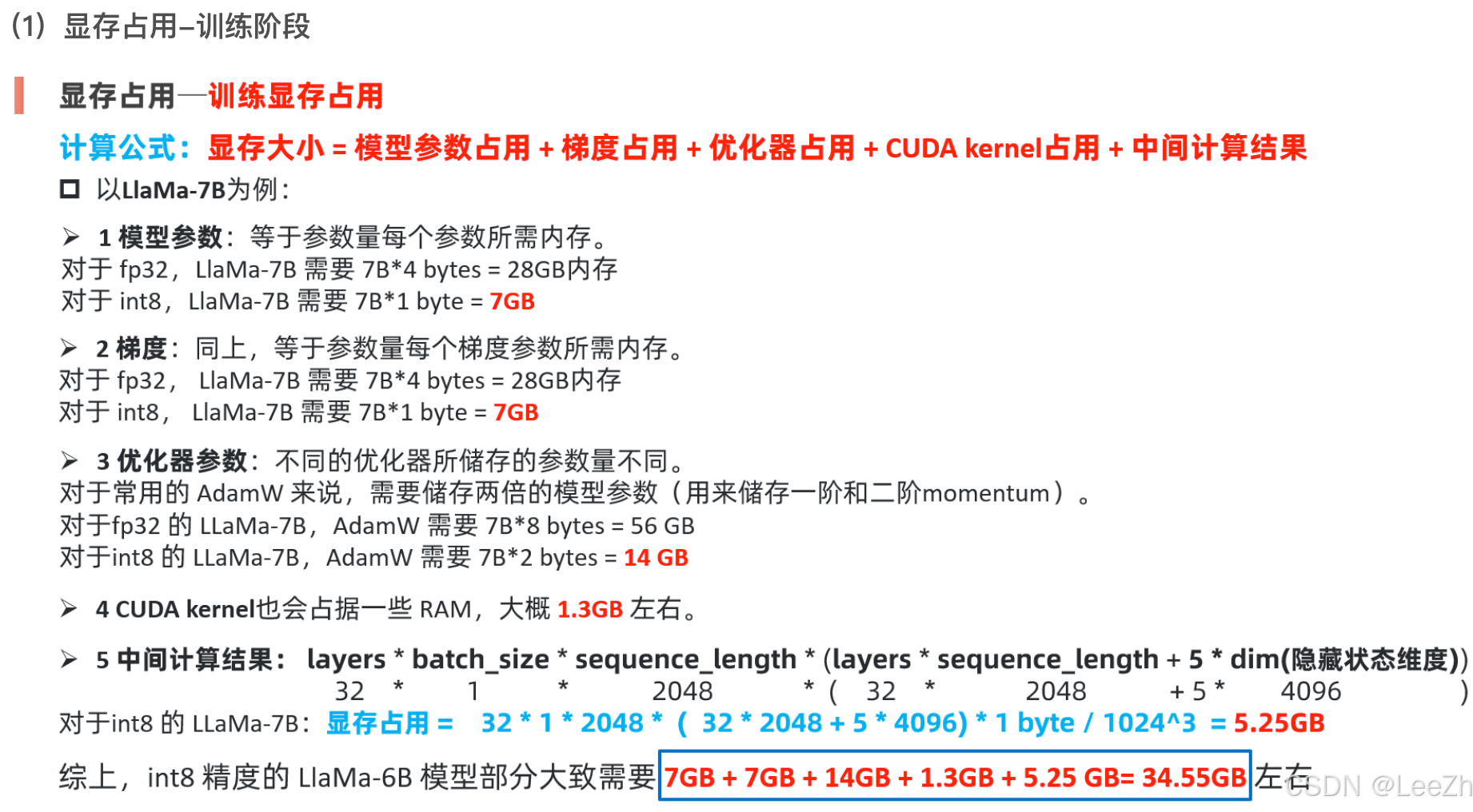

训练阶段粗略估算:

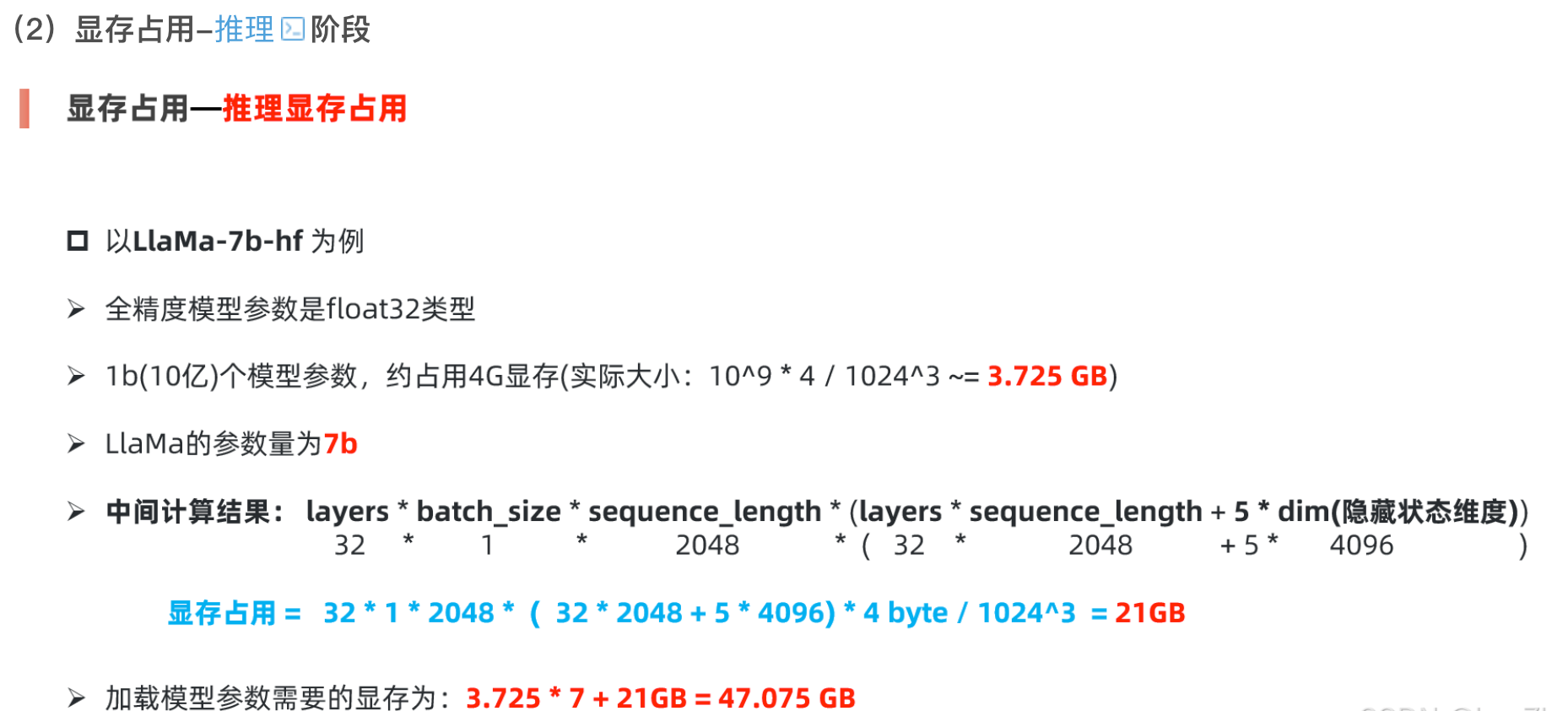

总显存 ≈ 参数显存 × (4 + 2/n)。其中,n为数据并行卡数。例如,单卡训练7B模型,参数显存14GB,总需求约14GB×6=84GB。推理阶段粗略估算:

总显存 ≈ 参数显存 + KV缓存。KV缓存可按2 × 序列长度 × 层数 × 隐藏层维度 × 精度进行粗略估算。快速参考:下表提供了不同规模模型在典型配置下的显存需求参考。

案例:

四、核心优化技术全景图

面对显存高墙,业界已发展出从算法、框架到底层硬件的多层优化技术。

1. 架构与算法优化

混合专家模型:如DeepSeek-V2采用的MoE架构,在推理时每个token仅激活少数专家(如2个),从而将有效计算参数量降低80%,大幅节省显存和计算开销。

量化技术:将模型权重和激活值从FP16降低到INT8甚至INT4,可直接将显存占用减半或压缩至1/4。例如,将14B模型量化为INT4,显存占用可从28GB降至7GB。KV缓存量化也是研究热点。

梯度检查点:以前向传播时重计算部分激活值为代价,换取显存的极大节约。该技术可减少约60%-70%的激活值显存占用,是训练大模型的标配。

注意力机制优化:针对KV缓存膨胀问题,可采用稀疏注意力、滑动窗口注意力或KV缓存逐头卸载(Head-wise Offloading)等先进方法,将注意力计算复杂度从O(n²)降低至O(n log n)或更低。

2. 并行策略与工程优化

分布式训练策略:当单卡无法容纳模型时,必须使用并行技术。

数据并行:每张卡持有完整模型副本,处理不同数据。

模型并行/张量并行:将单个模型的层或运算拆分到多张卡上。

流水线并行:将模型按层切分到不同设备,以流水线方式计算。

ZeRO优化器:微软DeepSpeed的核心技术,通过将优化器状态、梯度和模型参数在三阶段中分割到各张GPU,几乎消除了数据并行中的显存冗余。使用ZeRO-3可在8卡集群上将单卡显存占用降低数倍。

统一内存与CPU卸载:

NVIDIA Grace Hopper/Blackwell:通过NVLink-C2C实现CPU与GPU内存的统一寻址,让GPU能直接访问庞大的CPU内存,突破物理显存限制。

苹果M系列芯片:其统一内存架构(UMA)允许CPU、GPU和神经网络引擎高效共享大容量内存,使得在256GB内存的Mac Studio上运行450GB+需求的模型成为可能。

推理卸载系统:如prima.cpp和HeadInfer,系统性地将部分模型层或KV缓存卸载到CPU内存甚至磁盘,使消费级硬件也能运行300亿以上参数的模型。

五、实战指南:不同场景的配置与优化选择

场景一:有限资源下的模型微调与实验

目标:在单张消费级显卡(如24GB的RTX 4090)上微调7B-13B模型。

关键技术组合:

QLoRA:将模型量化为4位,并仅对低秩适配器(LoRA)进行微调,可将显存需求控制在8-16GB。

梯度检查点:启用以进一步节省激活值内存。

梯度累积:模拟大批次训练,同时保持小批次显存占用。

工具:可使用集成这些优化的Hugging Face

PEFT库或Unsloth等高效框架。

场景二:生产环境的高吞吐量推理服务

目标:以高吞吐、低延迟服务数十亿参数模型。

关键技术组合:

模型量化:采用INT8/FP8量化,在不显著损失精度的情况下,将服务成本减半。

动态批处理:将多个用户请求智能打包成一个计算批次,最大化GPU利用率。

持续批处理:在处理流式生成请求时,动态插入新请求并释放已完成的序列,避免GPU空闲。

使用专用推理引擎:如NVIDIA TensorRT或vLLM,它们集成了内核融合、内存高效管理等深度优化。

场景三:超大规模模型的训练

目标:训练千亿参数级别的模型。

关键技术组合:

3D并行:结合张量并行、流水线并行和数据并行。

ZeRO-3:全面分割所有模型状态,是百亿以上模型训练的基石。

混合精度与激活检查点:均为标配。

硬件选择:推荐使用NVIDIA H100/A100等具有高带宽内存和NVLink互联的GPU集群。未来,单卡显存高达192GB的Blackwell架构(B200)将显著减少所需卡数。

六、前沿趋势与未来展望

算法-硬件协同设计:如苹果M系列芯片和NVIDIA Grace超级芯片,通过底层统一内存架构,从根本上重构数据流,是突破“内存墙”的最有力途径。

更极致的动态稀疏化:未来的模型可能在训练和推理中,动态激活更少的参数(如低于10%),从源头上降低显存和计算需求。

存储层级扩展:利用CXL等高速互联协议,将CPU内存和NVMe固态硬盘作为GPU显存的可信扩展,构建成本更低的“万亿参数”单机方案。

自动化与智能化:基于强化学习的自动化配置优化器,将根据目标(时延、成本、精度)动态选择最优的并行策略、量化方案和卸载策略。