事先说明,目前市面上的RAG框架很多有低代码平台构建的RAG,有高校和研究所自主开发的一站式RAG平台,还有大型模型厂商的组件式工具库,等等本文不在一一列举,仅列举和说明目前主流的RAG框架。

随着大语言模型(LLM)在各行各业的落地应用,Retrieval-Augmented Generation(检索增强生成,简称 RAG)已成为提升模型实用性和准确性的关键技术。无论是企业优化客户服务,还是科研机构挖掘专业知识,RAG 的身影无处不在。

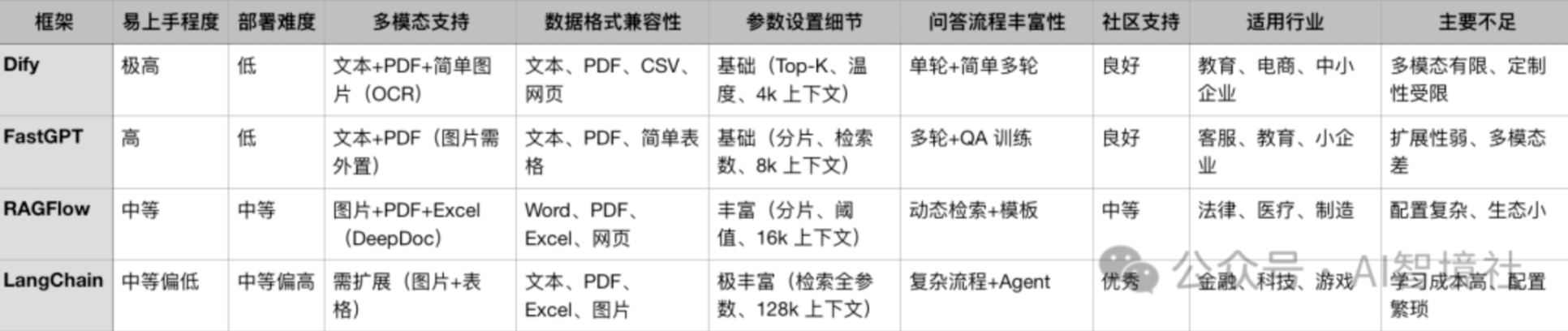

本文将深入探讨 RAG 的必要性,并对比 Dify、FastGPT、RAGFlow 和 LangChain 这四个广受欢迎的框架,从功能深度、适用场景等维度为你提供选择依据。

文末有详细对比表格。小编后续将持续更新 RAG 实践内容,关注不走丢!

RAG:大语言模型落地的“秘密武器”

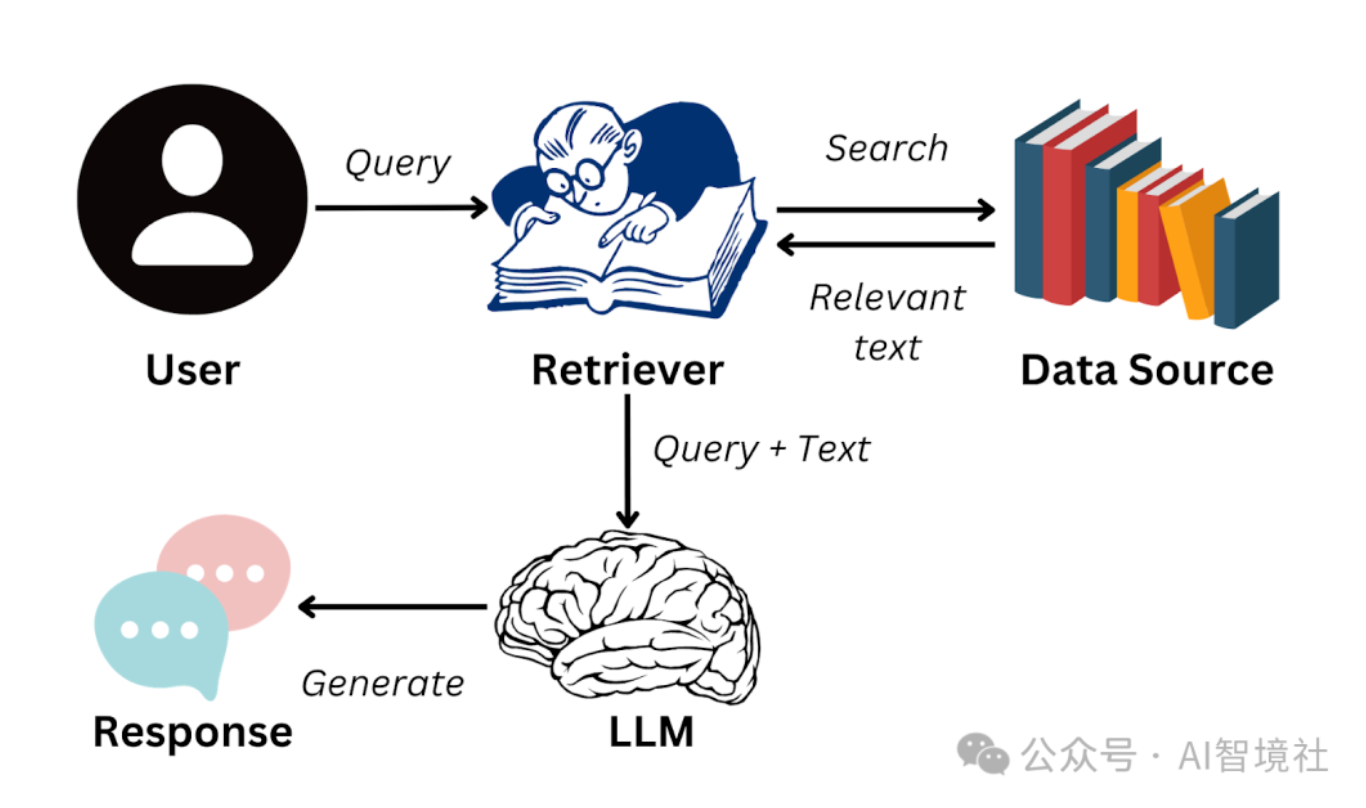

大语言模型凭借强大的语言生成能力席卷各领域,但其静态知识库存在时效性不足和专业性有限的问题。例如,询问企业最新政策时,模型可能无能为力;处理复杂表格或图像数据时,可能生成不可靠的回答。RAG 通过检索外部动态数据(如文档、数据库)并结合生成技术,显著提升了模型的上下文相关性和准确性,成为 LLM 落地的核心推动力。

这也解释了为何企业和单位热衷于搭建 RAG 系统。企业利用 RAG 开发智能客服,提升响应效率;科研机构整合文献资源,加速知识挖掘;开发者则打造个性化助手,满足多样化需求。RAG 的价值在于将模型与实时数据桥接,适应复杂多变的应用场景。

为什么需要 RAG 框架?

RAG 的实现涉及数据预处理、检索系统构建和生成模型集成,看似简单,实则充满挑战。数据需支持多模态输入(如文本、图片、表格),检索需优化召回率和精确度,生成则需精细调整提示词和参数。这些环节对技术栈、计算资源和优化经验要求较高,单靠手动开发效率低下且易出错。

RAG 框架应运而生。RAG 框架是什么? 它是一套集成检索与生成功能的工具集,通过模块化设计和预配置功能,简化了从数据接入到结果输出的流程。框架不仅降低开发门槛,还提供多模态支持、参数调优和流程定制能力,确保系统在性能、可扩展性和隐私性上的平衡。

市面这么多框架,怎么选?

RAG 框架种类繁多,从国际知名的 LangChain 到国内新兴的 Dify,各有千秋。为帮助读者准确决策,我们选取 Dify、FastGPT、RAGFlow 和 LangChain 进行深入分析和对比。以下将分析其特点、优势与不足,并结合适用行业和场景提供建议。

1. Dify:低代码快速开发的 LLM 平台

特点

Dify 是一个开源 LLM 应用开发平台,RAG 功能集成于其核心模块,提供拖拽式界面,支持知识库构建和问答生成。

优势

低代码开发

通过直观的 Web UI,非技术用户也能快速上手,支持文本和 PDF 文件上传,内置 OCR 可处理简单图片(需配合多模态 LLM,如 LLaVA),部署 RAG 应用仅需数分钟。

集成性强

兼容主流 LLM(OpenAI、Anthropic、通义千问)和向量数据库(Chroma、Weaviate),支持基础参数调整,如嵌入模型选择(Hugging Face 的 BGE、BCE 等)、检索 Top-K(默认 5,可调至 20)、生成温度(0.0-1.0)。

云+本地灵活

:社区版免费自托管,付费云服务提供额外支持,支持单轮问答和简单多轮对话(上下文窗口最大 4k 令牌)。

缺点

多模态能力有限

Excel 需预转为 CSV,复杂表格和多层嵌套文档解析能力不足,图片处理依赖外部模型。

定制化受限

模块化设计限制深度调整,高级参数(如分片策略、向量维度)需通过 API 修改,缺乏复杂检索策略(如重排序、语义路由)。

检索精度一般

依赖外部嵌入模型,问答流程仅支持简单上下文管理(基于最近 3 轮历史),生成质量受限于接入的 LLM API。

适用行业与场景

教育

快速开发课程问答助手。

电商

构建客服机器人回答常见问题。

中小企业

低成本上线 AI 解决方案。

2. FastGPT:轻量高效的知识库问答工具

特点

FastGPT 是一个开源平台,专注于知识库问答,提供可视化工作流,支持文档上传和自动化 QA 生成。

优势

简单易用

可视化界面和自动化预处理降低上手难度,支持文本、PDF 和简单表格(CSV),内置 QA 分割工具提升答案针对性。

轻量高效

针对中小规模数据优化,资源占用低,参数配置包括分片大小(默认 512 字符,可调至 2048)、检索数量(默认 3,可调至 10)。

知识库特化

支持多轮对话和上下文关联(最大 8k 令牌),开源免费,社区活跃。

缺点

多模态短板

图片需手动提取文本,Excel 仅支持简单表格,暂无内置多模态 LLM 支持。

扩展性有限

不支持分布式部署,问答流程较为线性(缺乏动态分支或 Agent 协作),高并发场景表现不佳。

生成能力依赖

推理质量受限于底层 LLM,参数调整深度有限。

适用行业与场景

客服

构建 FAQ 问答机器人。

教育

基于教材生成知识问答。

小型企业

管理内部文档,提供自助查询。

3. RAGFlow:深度文档理解的高精度引擎

特点

RAGFlow 是一个开源 RAG 框架,专注于复杂文档的检索与理解,支持多模态输入和可视化调试。

优势

深度文档处理

内置 DeepDoc 引擎,支持图片(OCR 提取文本)、PDF、Excel 和网页的智能解析,能处理多列 PDF 和嵌套表格,近期版本(v0.17.2)新增多模态 LLM 支持。

高精度检索

提供可视化分块和引用追踪,参数调整丰富(分片策略、嵌入模型如 BGE、检索阈值 0.7-0.9、重排序 PageRank、上下文窗口 16k 令牌),确保结果相关性。

开源自托管

免费部署,数据隐私有保障,支持 GPU 加速,问答流程支持动态检索(如 GraphRAG)和模板定制。

缺点

上手门槛较高

需 Docker 和依赖管理,配置复杂,对非技术用户不够友好。

生态较小

社区和插件支持不如 LangChain,扩展功能需自行开发。

资源需求高

处理大文档需 GPU 支持,硬件要求较高。

适用行业与场景

法律

处理合同和案例文档。

医疗

解析医学报告和文献。

制造业

管理技术手册和设备说明。

4. LangChain:高度灵活的 RAG 全能框架

特点

LangChain 是全球领先的 RAG 框架,采用模块化架构,支持多种向量数据库、嵌入模型和 LLM。

优势

高度灵活

支持自定义检索器和链式逻辑,兼容文本、PDF、Excel(需转为 CSV/JSON)、图片(需扩展)和网页,参数调整包括分片大小(默认 1000 字符)、嵌入维度(768-4096)、检索策略(混合搜索、重排序)、上下文长度(最大 128k 令牌)。

生态丰富

集成众多 LLM 和数据库,问答流程支持多轮对话、Agent 协作和复杂检索(如 LangGraph),社区庞大。

持续更新

紧跟技术前沿,开源免费,开发成本可控。

缺点

学习曲线陡峭

需 Python 编程能力,多模态支持需手动集成(如 pdf2image、Tesseract)。

配置繁琐

功能强大但需优化,效果依赖底层组件。

性能依赖外部

多模态和高级功能需额外调优。

适用行业与场景

金融

处理复杂报表和投资分析。

科技

开发创新型 AI 应用。

游戏

构建动态对话系统。

全面对比

没有完美的框架,最有最适合项目和场景的选择,希望这篇文章对于怎么选择适合您的RAG框架,有所帮助:

快速上线,非技术团队

选 Dify,低代码设计和集成性适合教育、电商。

轻量问答,小型项目

选 FastGPT,简单高效,满足客服和教育需求。

复杂文档,高精度需求

选 RAGFlow,多模态和检索能力适配法律、医疗。

深度定制,技术驱动

选 LangChain,灵活性和生态支持金融、科技。

结语

RAG 框架是大语言模型落地的重要支柱,而 Dify、FastGPT、RAGFlow 和 LangChain 在功能和场景上各有专长。

初学者可从 Dify 或 FastGPT 起步,快速体验 RAG;

文档密集型需求选 RAGFlow;

技术团队则可挑战 LangChain。